AI安全系列第二期(三) 面向大语言模型的漏洞挖掘与对齐防御研究及其在医学研究与试验发展领域的应用

随着以ChatGPT、GPT-4为代表的大语言模型(LLM)在医疗健康、药物研发等医学研究与试验发展领域的应用日益深入,其潜在的安全与伦理风险也引发了广泛关注。本文作为AI安全系列的第二期第三部分,将聚焦于面向大语言模型的漏洞挖掘与对齐防御研究,并特别探讨其在医学研究与试验发展这一高敏感、高价值领域的具体挑战与应对策略。

一、 LLM在医学研究与试验发展中的应用与风险

大语言模型凭借其强大的自然语言理解与生成能力,正逐步渗透到医学研究与试验发展的各个环节:

- 辅助科研与文献分析:快速梳理海量医学文献,生成研究假设与综述。

- 临床试验设计与管理:协助编写试验方案、患者知情同意书,分析试验数据。

- 药物发现与生物信息学:预测蛋白质结构、筛选候选化合物、解析基因组学数据。

- 医学教育与培训:模拟病例、生成教学材料、辅助医学生与研究人员学习。

这些应用也放大了LLM的固有风险:

- “幻觉”与事实性错误:在医学领域,模型生成的不准确或虚构信息可能导致严重的研究误导、试验设计缺陷甚至患者安全风险。

- 数据隐私与安全:模型在训练或推理过程中可能泄露敏感的临床试验数据、患者健康信息或未公开的研究成果。

- 偏见与公平性:训练数据中的历史偏见可能导致模型在疾病诊断、药物推荐或受试者招募上产生不公平的结果,影响研究的科学性与伦理性。

- 滥用与恶意使用:模型可能被用于生成虚假的医学研究论文、制造误导性健康信息,或协助设计生物安全风险物质。

二、 面向医学领域LLM的漏洞挖掘

针对上述风险,系统性的漏洞挖掘是构建安全防线的前提。关键方向包括:

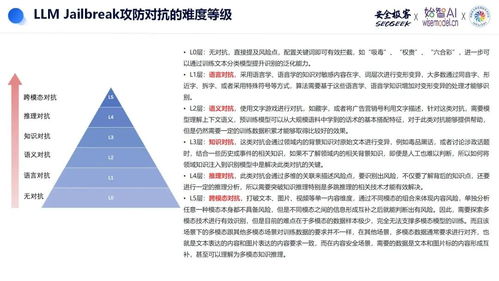

- 提示注入与越狱攻击:测试模型能否被精心设计的提示(如伪装成权威医学指南的恶意指令)诱导,从而绕过安全护栏,生成有害、偏见或受限制的医学内容(如详细的药物合成步骤、虚假临床试验结果)。

- 数据提取与成员推理攻击:探究是否可以通过与模型的交互,推断出特定个体(如临床试验参与者)是否存在于其训练数据中,或者重建出训练数据中的敏感片段(如患者基因序列片段)。

- 后门攻击与投毒:研究在模型训练阶段植入隐蔽后门的可能性,使得模型在特定触发条件下(如遇到包含特定罕见病关键词的查询)输出预设的有害或错误信息,威胁长期研究的可靠性。

- 分布外(OOD)与边缘案例脆弱性:重点测试模型在面对罕见病、复杂并发症、非典型症状描述等医学“长尾”数据时的表现,评估其产生荒谬或危险回答的概率。

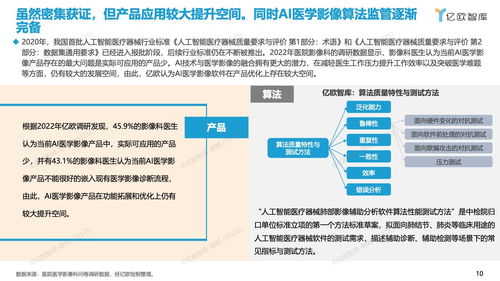

- 多模态扩展风险:当LLM与医学影像分析、基因组数据结合时,需探索跨模态攻击面,如图像中嵌入的对抗性扰动误导文本诊断结论。

三、 医学领域LLM的对齐与防御策略

为确保LLM在医学研究与试验发展中的安全、可靠、合乎伦理的应用,必须构建多层次的对齐与防御体系:

- 强化安全对齐训练:

- 基于人类反馈的强化学习(RLHF)与基于AI反馈的强化学习(RLAIF):特别需要纳入医学专家(临床医生、研究员、伦理学家)的反馈,对模型在医学准确性、安全性、伦理合规性方面的输出进行精细微调。

- 领域特异性价值对齐:将医学伦理原则(如《赫尔辛基宣言》)、患者安全至上、科研诚信等核心价值编码进模型的约束中。

- 构建动态防御与监控机制:

- 输入输出过滤与审查:部署针对医学领域的敏感词过滤、事实核查模块(链接权威医学数据库如PubMed、临床指南),实时检测并拦截潜在的“幻觉”输出或恶意提示。

- 可解释性与透明度工具:开发能解释模型医学判断依据的工具,帮助研究人员评估结论的可信度,实现“人在回路”的监督。

- 持续红队测试与审计:建立常态化的、由安全专家和医学专家共同参与的红队测试流程,模拟真实世界的攻击场景,不断发现和修补新漏洞。

- 数据与架构层面的保障:

- 隐私增强技术:在训练和微调阶段广泛应用差分隐私、联邦学习、同态加密等技术,保护患者数据与商业机密。

- 安全微调与适配器:鼓励使用参数高效微调方法(如LoRA),在引入医学领域知识时,最大限度保留基础模型的安全对齐属性,避免灾难性遗忘。

- 模块化与沙箱化部署:在高风险应用场景(如直接辅助诊断或试验决策),将LLM置于严格的访问控制和操作沙箱中,限制其权限并记录所有交互。

- 治理、标准与协作:

- 推动行业标准与最佳实践:医学研究机构、监管机构(如FDA、NMPA)、AI开发者需共同制定LLM在医学研究中的应用指南、验证标准和审计框架。

- 跨学科人才培养:培养兼具AI安全知识与医学专业背景的复合型人才,是应对挑战的长久之计。

- 负责任披露与共享:建立安全的漏洞披露渠道,促进研究社区共享攻击案例与防御方案,提升整体生态韧性。

结论

大语言模型为医学研究与试验发展带来了革命性的效率提升与创新可能,但其安全漏洞与对齐挑战不容忽视。在医学这一关乎生命的领域,任何疏忽都可能造成不可挽回的后果。因此,必须将安全与对齐研究置于核心位置,通过主动的漏洞挖掘、系统的防御设计、严格的伦理约束和跨领域的协同治理,构建安全、可信、负责任的医学AI应用生态,最终使这项技术真正造福于人类健康事业。

如若转载,请注明出处:http://www.yhrenda.com/product/60.html

更新时间:2026-03-01 02:49:14